一方面,人工智能可協(xié)助人類指揮官指揮快速復(fù)雜的作戰(zhàn)行動,直接為“任務(wù)式指揮”提供決策支持能力:一是縮短己方?jīng)Q策時間,二是運用迷惑、干擾等手段增加敵方?jīng)Q策時間。美《陸軍條令》將“任務(wù)式指揮”定義為:“在一體化地面作戰(zhàn)過程中,指揮官通過使用任務(wù)式指揮行使權(quán)力和進(jìn)行指揮,以使具有靈活性和適應(yīng)性的領(lǐng)導(dǎo)者在按照指揮官意圖的前提下發(fā)揮符合作戰(zhàn)紀(jì)律的主動性。”簡而言之,美軍所說的“任務(wù)式指揮”即上級指揮官只向下級指揮官下達(dá)任務(wù)目的,而不規(guī)定完成任務(wù)所使用的手段和方式。然而,目前的實踐表明這一指揮方式容易對己方“判斷”環(huán)節(jié)造成消極影響。因為基層指揮官缺乏高級參謀的協(xié)助,會造成誤判或是又回到按習(xí)慣指揮的老路上,反而使敵方更容易預(yù)測其行動。馬賽克戰(zhàn)將人類的創(chuàng)造性與人工智能的強大運算能力相結(jié)合,人工智能可以為指揮官提供計算工具,賦予基層指揮官快速控制分散的部隊、適應(yīng)戰(zhàn)場空間環(huán)境的能力,以此克服“任務(wù)式指揮”的局限性,并縮短決策時間使己方獲取決策優(yōu)勢,也給敵方?jīng)Q策施加困境。

美陸軍正在利用人工智能技術(shù)制定新的“任務(wù)式指揮”概念,將機器學(xué)習(xí)與任務(wù)指揮能力相結(jié)合,以提升人類在任務(wù)規(guī)劃、準(zhǔn)備和執(zhí)行過程中的決策能力。其核心是由對機器人收集的數(shù)據(jù)進(jìn)行合理的管理、處理和分發(fā),讓機器人成為人的得力助手,從而使人能夠更快、更有效地做出決策。在干擾、欺騙敵方?jīng)Q策方面,美軍正在探索利用“深度偽造”技術(shù)合成假音頻、假視頻投放至敵軍內(nèi)部,向敵軍下達(dá)錯誤命令,干擾敵指揮控制系統(tǒng),致使敵方?jīng)Q策失誤。

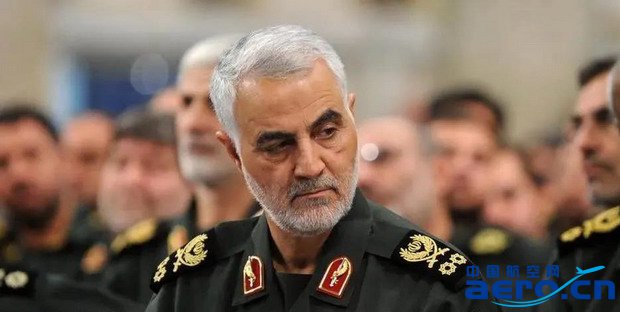

被美國刺殺的伊朗將領(lǐng)蘇萊曼尼

另一方面,人工智能可輔助人類情報分析師綜合評估海量戰(zhàn)場信息,間接輔助指揮官決策。情報是決策的基礎(chǔ),《孫子兵法》中充分強調(diào)了“知”的重要性,認(rèn)為“知彼知己,勝乃不殆;知天知地,勝乃可全”,這里的“知”指的就是情報。在充滿不確定性、瞬息萬變的復(fù)雜戰(zhàn)場環(huán)境下,尤其是時間緊迫時,人工智能能夠比人類情報分析師更高效快速解讀碎片化甚至是相互矛盾的海量信息,還可接收和過濾相關(guān)實時信息,幫助制定作戰(zhàn)決策。2019年1月,美國家情報總監(jiān)辦公室頒布了指導(dǎo)美國情報界人工智能技術(shù)發(fā)展的綱領(lǐng)性文件——《AIM倡議:機器增強情報戰(zhàn)略》,旨在通過重點發(fā)展和快速采用人工智能、自動化和增強(AAA)技術(shù),利用“機器增強情報”戰(zhàn)略來指導(dǎo)美國情報界的人工智能工作,以提高情報工作效率、任務(wù)能力和決策能力。美國防情報局、國防高級研究計劃局、地理空間情報局等多家軍事情報機構(gòu)都在如火如荼地發(fā)展人工智能項目計劃,試圖將人工智能技術(shù)優(yōu)勢轉(zhuǎn)化為情報決策優(yōu)勢。比如地理空間情報局將智能處理技術(shù)運用于戰(zhàn)場空間情報分析,使指揮員能夠全維實時感知戰(zhàn)場態(tài)勢,從而快速做出決策。

殺傷打擊精確化

殺傷打擊精確化是智能化戰(zhàn)爭制勝的決定性要素之一。智能化戰(zhàn)爭中的精確殺傷打擊是指在人工智能時代,以人工智能技術(shù)為核心,綜合多種嵌入人工智能算法的武器裝備平臺為手段,在多重維度實施精確打擊。相對信息化戰(zhàn)爭中傳統(tǒng)的精確打擊而言,智能化戰(zhàn)爭中的精準(zhǔn)定制殺傷融合了多種快速發(fā)展中的人工智能技術(shù),具備五大新特點:情報檢索高效快速,目標(biāo)鎖定“化整為零”,殺傷流程趨于自主,作戰(zhàn)編組靈活分散,殺傷效果集約可控。

美國空軍上校約翰·博伊德

人工智能精準(zhǔn)定制殺傷的原理是利用深度學(xué)習(xí)以及綜合機器視覺技術(shù),進(jìn)行目標(biāo)篩選和追蹤,同時發(fā)揮人工智能在態(tài)勢感知、運算速度方面的巨大優(yōu)勢,引導(dǎo)火控系統(tǒng)根據(jù)實時情況快速精準(zhǔn)評估,并根據(jù)打擊效果實時調(diào)整任務(wù)和戰(zhàn)術(shù)。在殺傷效果上,精準(zhǔn)定制殺傷根據(jù)目標(biāo)屬性、戰(zhàn)場環(huán)境和殺傷要求,自主定制并調(diào)整攻擊組合、時序與方式,達(dá)成警告、干擾、壓制、降級、失能等多種損傷效果。例如美軍在刺殺蘇萊曼尼時使用的AGM-114R9X型地獄火導(dǎo)彈直接將目標(biāo)人物殺死在車輛內(nèi)部,除目標(biāo)車輛車身遭受巨大的破壞外,對周邊目標(biāo)造成的傷害幾乎可以忽略不計。美陸軍2020年秋在“項目融合”演習(xí)中測試殺傷鏈,其流程為:來自低軌衛(wèi)星、灰鷹無人機以及地面?zhèn)鞲衅鞯臄?shù)據(jù)傳輸至指揮控制中心,指控中心利用人工智能對數(shù)據(jù)進(jìn)行分類、處理和分析,計算出打擊該特定目標(biāo)的最佳武器,M109自動榴彈炮、灰鷹無人機或地面平臺向目標(biāo)開火,整個過程不到20秒。

風(fēng)險:可靠性與安全性有待考量

人工智能雖然在優(yōu)化美軍殺傷鏈流程中表現(xiàn)出巨大應(yīng)用潛力,能夠使目標(biāo)識別精確化,定位跟蹤實時化,決策過程快速化,殺傷打擊精確化,但是在技術(shù)安全性、人機關(guān)系、法律等方面的安全性和可靠性仍有待考量。

一是技術(shù)安全性問題。當(dāng)下人工智能技術(shù)的成熟運用仍存在諸多阻礙和風(fēng)險。從殺傷鏈中敵我雙方對抗的角度看,一方面,己方的目標(biāo)識別、跟蹤系統(tǒng)還無法完全做到智能化,民用領(lǐng)域曾出現(xiàn)過自動駕駛車輛由于未識別出行人而釀成撞人致死事故,以此為鑒,軍事領(lǐng)域的應(yīng)用要十分審慎;另一方面,敵方如果利用諸如“深度偽造”的人工智能技術(shù)手段故意釋放迷惑性信息欺騙我方,或者用一般的技術(shù)手段篡改我方人工智能算法,致使我方殺傷鏈流程的任意一環(huán)出現(xiàn)錯誤,其后果都將不堪設(shè)想。

AGM-114地獄火空地導(dǎo)彈

二是人機關(guān)系問題。通過前文的分析,不可否認(rèn)的是,人工智能確實能夠以其強大的數(shù)據(jù)處理、分析和融合能力,在復(fù)雜多變的戰(zhàn)場環(huán)境下減輕參謀人員和指揮官的負(fù)擔(dān),甚至能夠模擬人類思維進(jìn)行感知和判斷。但是在人機關(guān)系層面,無論人工智能技術(shù)發(fā)展到多么成熟的程度,殺傷鏈中的決策權(quán)都必須牢牢掌握在人類手中,人類在決策環(huán)節(jié)必不可少。因為人工智能技術(shù)只要掌握了正確的算法和合適的數(shù)據(jù),就可以很快地對目標(biāo)發(fā)動精準(zhǔn)殺傷打擊,如果將是否發(fā)動攻擊的決策權(quán)交由人工智能,那么將給未來的國家安全造成巨大隱患,這一點不亞于克隆技術(shù)被濫用的危害。人工智能的使用必須有邊界,即決定權(quán)要交由人類。

三是法律問題。法律的出臺是為了保護(hù)人工智能技術(shù)的健康發(fā)展,規(guī)定其邊界,使其不被濫用。目前國際社會對于人工智能軍事化應(yīng)用的立法還尚未成熟。試想,如果嵌入了人工智能算法的一枚導(dǎo)彈在識別目標(biāo)時出現(xiàn)失誤,將無辜平民誤判為打擊目標(biāo)而殺死,那么,其背后應(yīng)該受到法律制裁的主體應(yīng)該是誰,各個主體又該承擔(dān)多少責(zé)任,都缺乏法律的界定。